Date : 2019

06

04Tue.

シンプルな意味理解から感情・心理・健康状態認識に進化、音声認識技術が体験にもたらすインパクト

アフターデジタル

グローバルトレンド

より良い体験を生み出すためには、パーソナライゼーションが必須であることは周知のことですが、その多くの施策が検索履歴など過去データをもとにレコメンドするなど「静的」なものにとどまっているのが現状といえるでしょう。 より精度の高いパーソナライゼーションを実現するためには、ユーザの性格だけでなく、リアルタイムに変化する心理・感情の状態を読み取ることが重要となります。つまり「動的」なアプローチが必要になるということです。 では、どのようにリアルタイムに変化するユーザの心理・感情を読み取ることができるのか。その方法の1つとして注目を集めているのが「声データ」をもとにした解析・予測技術です。

声にはテキストでは分かりえないユーザのさまざまな情報が含まれています。話すスピードや音量だけでなく、単語、方言、抑揚、自分では気づかない声の波形の変化などから、出身地、性格に加え、感情・心理・健康状態までも予測することが可能になっているのです。

この情報を活用することで精度の高いレコメンドや効果的な顧客満足度改善対策などを実現できると考えられます。

今回は、声データがどのように活用されようとしているのか、海外の最新事例から先端動向を探ってみたいと思います。

スタートアップからアマゾンまで、激化する「ボイステック」開発競争

アマゾン・アレクサへの注目度の高さに見るように、「ボイステック」への関心と期待は高まっているといえます。

しかし、これまでボイステックといわれてきたのは主に「言葉の意味を『文字通り』理解」する技術のことで、言外の意味を捉えるというのは、その範疇には入っていませんでした。

しかし、声のデータベースが構築され、人工知能による解析が進んでいるいま 、声から言葉の意味だけでなく、言外の意味、感情、心理状態、健康状態などさまざまなことが推定・予測できるようになっています。

実際にサービスやビジネスオペレーションに導入する 動きが出てきており、今後この動きは広がりを見せるかもしれません。

感情認識技術を開発するスタートアップNeurodata Labは2019年3月、ロシア金融機関Rosbankのコールセンターに、声によるリアルタイム感情認識技術を導入する計画を発表しました。この技術は、オペレーターと顧客の会話における、 声の大きさや、 会話の長さなどを分析し、リアルタイムに顧客の満足度を指数化。この情報によって、オペレーターは適宜対応を変え、顧客とのコミュニケーションを円滑化することが可能となります。

コールセンターでの会話はお互い顔が見えないため、ミスコミュニケーションが起こりがちといえます 。人間はコミュニケーションを取る際、相手の感情や心理状態を推察し、 対応を変えていますが、多くの場合相手の表情という視覚情報から判断しているといえるでしょう 。

この 視覚情報がない状態では、相手がどのような感情や心理状態なのかを推察することは困難となります。声のみが判断の頼りとなりますが、声の微妙な違いを聞き分けることは難しく、人間の力だけでは適切な判断が下せないことがほとんどです。また「本音と建前」という言葉が示すように、言葉そのものが話者の本音を表さない場合が多いことも、音声のみのコミュニケーションを難しくしている要因と言えるでしょう。

人間では 聞き分けが難しい声の微妙な違いもビッグデータと人工知能の組み合わせによって、推察・予測可能なものになっているのです。

イスラエル発のスタートアップVoice Senseは、声の抑揚、スピード、ストレスレベルなどから感情・心理状態に加え、性格までも予測する音声・感情認識技術を開発しています。リスク選好、衝動性、社会性、ルール遵守度合いなどを予測し、そのデータを顧客管理システムに統合できるといいます。これにより、顧客が将来どのような行動を取るのか予測することが可能になるようです。

リテール から金融、人材、医療など幅広い分野での応用が想定されています。たとえば、リテールであれば購買行動の予測、人材分野では社員の継続性・退職率の予測などが考えられます。

Voice Senseは人材分野に特化したソリューションも開発 。採用面接の際に記録されたビデオまたは音声データと、 性格予測技術を応用し、候補者のやる気、コミュニケーション能力、協調性、創造性などを評価し、候補者がその役職に適切なのかどうかを判断します。

声によって感情・心理状態・健康状態などを予測する技術は、大手企業も注目し、多大な投資を行っています。

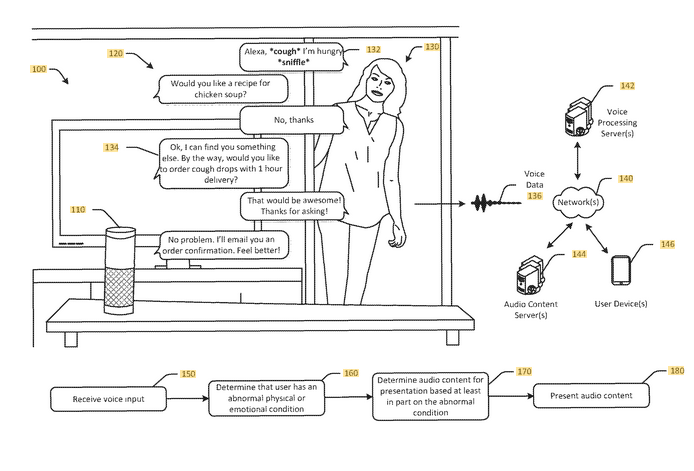

アマゾンは音声データからユーザの心身の健康状態を検知する技術を開発し、その特許を米国特許商標庁に申請しました(このほど特許が有効化)。

特許書類が示すところでは、アレクサが言葉だけでなく咳や鼻をすする音などからユーザの健康状態を把握し、その状態に応じた解決策を提示。感情・心理状態も検知できるといいます。これにより、ユーザとのインタラクションから得られた過去データに加え、心身状態や感情・心理状態などリアルタイムデータを加味した動的なレコメンド、さらには「人間のような」コミュニケーションが可能になります。

体験をエンリッチするのに必要なパーソナライゼーションですが、そこにはボット活用による自動化が欠かせません。現在、自動化というとコミュニケーションが無機質にならざるを得ない印象を持ってしまいますが、アマゾンが申請した特許は、ボットとのコミュニケーションが次の段階に進化することを物語っていると言えるでしょう。

潜在欲求を可視化する未来のボイステック

これらの先端技術がより進化し普及したとき、どのようなライフスタイルが実現するのか 。

1つは、Siriなどのパーソナル・アシスタントが、ユーザの性格からリアルタイムの感情・心理状態、さらには健康状態を予測し、それらを加味した本当に最適なソリューションを提示できるようになることが考えられるでしょう。

既存のパーソナル・アシスタントは、言葉を額面通りに受け取り、それに対応するシンプルなソリューションを提示しています。しかし、人間には「潜在欲求」といわれる自分では気付かない無意識レベルの欲求が存在します。また、健康状態によって求められる栄養素なども日々変化しています。

このような無意識下で欲するものや、細胞レベルで求められるものをパーソナル・アシスタントが検知し、それに応じたソリューションを提示することもできるようになるかもしれません。

たとえば「疲れた」という一言でも、それが何かに夢中になっていて小休止を入れたいというものなのか、または心身ともに疲れきっているシグナルなのかなど、さまざま状態が想定されますが、感情認識技術であれば、その一言からユーザの状態を把握し、小休止に最適なティータイムのプラン、または完全なリフレッシュを目的とした休暇プランなど、ユーザの心身の状態に応じた提案ができるようになることが考えられます。

目を見張るスピードで進化する音声・感情認識技術。今後の拡大フェーズを経て、社会をどのように変えていくのか、その可能性に期待が寄せられます。